복합적인 3D 객체 추정도 OK

원가 줄이고, 차량 경량화할 것

(내외방송=정지원 기자) 사진 한 장만으로 주변 물체를 효율적으로 추정하는 기술이 개발돼 자율주행 시대에 더 가까워질 전망이다.

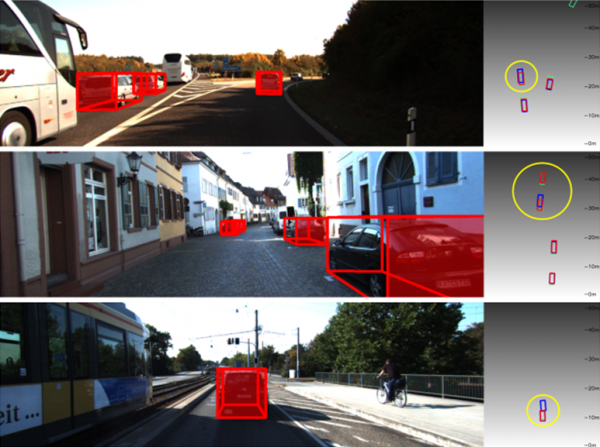

19일 DGIST(대구경북과학기술원)에 따르면, 임성훈 전기전자컴퓨터공학과 교수 연구팀이 단안(單眼) 카메라를 이용해 3D 객체의 위치를 높은 정확도로 추정할 수 있는 딥러닝 기술(컴퓨터가 스스로 학습하는 기술)을 개발했다.

자율주행에서 '3D 객체 추정'이 핵심기술로서 주변의 사람과 표지판, 차량 등 환경을 정확하게 인식해야 자동차가 안전하게 움직일 수 있다.

기존에 많이 사용하고 있는 단안 카메라를 이용한 객체 추정 방법은 비용이 절감된다는 장점이 있었지만, 한 장의 사진만으로 정확한 3D 정보를 얻어내는 데 한계가 있었다.

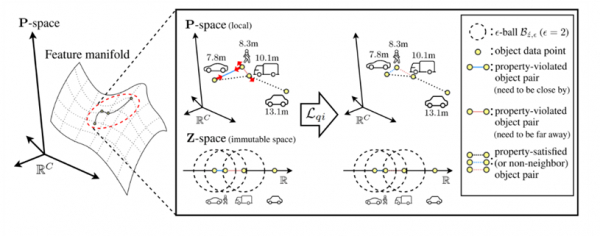

연구팀은 단안 카메라 추정 신경망이 객체의 깊이를 잘 구분할 수 있도록 새로운 '메트릭(측정 척도나 기법) 학습 기법'을 고안했다.

새로운 메트릭 학습 기법은 거리보존함수로 신경망이 인식한 공간 깊이 정보를 정렬해 객체 깊이를 쉽게 구분할 수 있게 해 성능을 높였다. 또, 매니폴드 학습(고차원을 축소해 저차원 데이터를 분석)을 활용한 거리 보존으로 복합적인 3D 객체 추정도 효율적으로 수행할 수 있었다.

이외에도 이미지에서 객체 위치를 정할 때 발생하는 오류를 보완할 수 있는 새로운 방법으로 3D 객체 추정 성능을 효과적으로 높였다. 이번 연구는 자율주행 기술의 원가를 줄이고, 차량을 경량화하는 등 응용될 것으로 보인다.

임 교수는 "이번 연구는 자율주행 시각 인지 모델의 연산 시간은 유지하면서 성능을 크게 향상시키는 기술"이라며 "자율주행 기술 발전에 매우 긍정적인 영향을 미칠 것"이라고 말했다.

최원혁 석박사통합과정과 신민규 석사과정이 함께 참여한 이번 연구는 국제학술지인 '신경정보처리시스템학회(Neural Information Processing Systems 2023)'에 게재 승인됐다(논문명: Depth-discriminative metric learning for monocular 3D object detection).